コンピュータビジョンの画像注釈とラベリング

究極のバイヤーガイド2023

コンピュータビジョンは広大なトピックであり、技術者や意欲的な起業家が短期間でそれらについて完全に知ることは不可能です。 特に、コンピュータビジョンに基づいた製品を開発していて、市場投入までの時間が限られている場合、機能的な知識を持ち、十分な情報に基づいて決定を下すには、コンピュータビジョンと画像注釈の基礎を知るための広範で実質的な何かが必要です。

このガイドでは、概念を厳選し、可能な限り簡単な方法で提示しているため、それが何であるかを明確に理解できます。 これは、製品の開発に取り掛かることができる方法、その背後にあるプロセス、関連する技術などについて明確なビジョンを持つのに役立ちます。 したがって、このガイドは、次の場合に非常に役立ちます。

概要

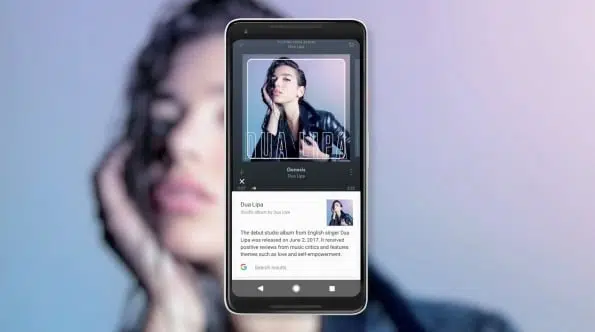

最近Googleレンズを使用しましたか? そうでなければ、私たち全員が待ち望んでいた未来が、その非常識な機能を探求し始めると、ついにここにあることに気付くでしょう。 Androidエコシステムのシンプルで補助的な機能であるGoogleレンズの開発は、技術の進歩と進化の面で私たちがどれだけ進んだかを証明するために続けられています。

単にデバイスを凝視し、人間から機械への一方向の通信しか経験しなかったときから、デバイスが私たちをじっと見つめ、分析し、処理することができる非線形相互作用への道を切り開きました。リアルタイム。

彼らはそれをコンピュータビジョンと呼んでおり、それはすべて、デバイスがカメラを通して見るものから現実世界の要素を理解し、理解することができるものについてです。 Googleレンズの素晴らしさに戻ると、ランダムなオブジェクトや製品に関する情報を見つけることができます。 デバイスのカメラをマウスまたはキーボードに向けるだけで、Googleレンズがデバイスのメーカー、モデル、メーカーを教えてくれます。

また、建物や場所をポイントして、リアルタイムで詳細を取得することもできます。 数学の問題をスキャンして解決策を見つけたり、手書きのメモをテキストに変換したり、パッケージをスキャンするだけでパッケージを追跡したり、インターフェースなしでカメラを使ってさらに多くのことを行うことができます。

コンピュータビジョンはそれだけではありません。 あなたがあなたのプロフィールに画像をアップロードしようとするとFacebookでそれを見たでしょう、そしてFacebookはあなたとあなたの友人や家族の顔を自動的に検出してタグ付けします。 コンピュータビジョンは、人々のライフスタイルを高め、複雑なタスクを簡素化し、人々の生活を楽にします。

しかし、なぜ私たちはこれをすべて言っているのですか?

それは簡単です。 私たちが今いるところにたどり着くのはそれほど簡単ではありませんでした。 Googleレンズが画像を即座に検出し、インターネット上にあるすべてのものを引き出すことができれば、何年もの進化とトレーニングが必要になります。 コンピュータビジョンの成功は、私たちが画像注釈と呼ぶものに完全に要約されます。これは、コンピュータとデバイスにインテリジェントで理想的な決定を行わせるテクノロジの背後にある基本的なプロセスです。

画像の注釈がなければ、コンピュータビジョンとその関連する利点はあり得ません。これはまさに、この広範なガイドで説明および調査しようとしていることです。 画像アノテーションの基本から、適切なベンダーを見つける方法まで、すべての側面を探ります。 これにより、より優れた製品を開発し、最終的に機械学習と深層学習モジュールの知識を広げることができます。

画像注釈とは

正直に言いましょう。 コンピュータは基本的でかなり馬鹿げています。 それらは、タスクを実行する方法についてスプーンで与えられる指示でなければなりません。 機械が人工知能、機械学習、深層学習を通じて自律的に考える能力を開発し、問題を解決するための最良の方法を考え出すことができるようになったのはごく最近のことです。

訓練を受けていないデバイスがヤシの木の画像を見るとき、それが何であるかを知りません。 その知識は、木が何であるかを学んでいない幼児の知識とほとんど同じです。 機械は、木が何であるか、そして世界のさまざまな種類の木を教えられなければなりません。

画像アノテーションはデータラベリングのサブセットであり、画像のタグ付け、文字起こし、またはラベリングの名前でも知られています。これには、バックエンドで人間が関与し、マシンがオブジェクトをより適切に識別するのに役立つメタデータ情報と属性を画像に絶え間なくタグ付けします。 木の同じ例を考えると、機械学習の専門家は、ヤシの木とは何か、どのように見えるかを指定して、木の画像に注釈を付けることに時間を費やしています。 これにより、デバイスはヤシの木を正確に検出できます。

ただし、プロセスはまだ完了していません。 椰子の木を検出するプロセスを機械が習得したように見えるかもしれませんが、柳の木の画像を表示した場合にのみ、機械の準備ができていないことに気付くでしょう。 そのため、専門家は画像に注釈を付けて、ヤシの木が「ない」ものを機械に指示する必要があります。 機械は、長年にわたる継続的なトレーニングを通じて、ニッチ、目的、データセットに応じて、オブジェクトをシームレスに検出および識別することを学習します。

コンピュータビジョンの画像注釈

画像アノテーションはデータラベリングのサブセットであり、画像のタグ付け、文字起こし、またはラベリングの名前でも知られています。画像のタグ付けにはバックエンドの人間が関与し、メタデータ情報と属性で画像にたゆまずタグを付けます。

画像データ

- 2D画像

- 3D画像

注釈の種類

- 画像分類

- オブジェクト検出

- 画像のセグメンテーション

- オブジェクトトラッキング

- 画像の文字起こし

注釈テクニック

- バウンディングボックス

- ポリライン

- ポリゴン

- ランドマーク注釈

どのような画像に注釈を付けることができますか?

- 画像とマルチフレーム画像、つまり動画は、機械学習用にラベルを付けることができます。 最も一般的なタイプは次のとおりです。

- 2Dおよびマルチフレーム画像(ビデオ)、つまり、カメラ、一眼レフ、または光学顕微鏡などからのデータ。

- 3Dおよびマルチフレーム画像(ビデオ)、つまり、カメラまたは電子、イオン、または走査型プローブ顕微鏡などからのデータ。

注釈付け中に画像にどのような詳細が追加されますか?

画像に含まれる内容をマシンがよりよく理解できるようにする情報には、専門家によって注釈が付けられます。 これは非常に労働集約的な作業であり、数え切れないほどの手作業が必要です。

詳細に関しては、プロジェクトの仕様と要件によって異なります。 プロジェクトで画像を分類するだけの最終製品が必要な場合は、適切な情報が追加されます。 たとえば、コンピュータビジョン製品が、スキャンしているものが木であることをユーザーに伝え、クリーパーや低木と区別することを目的としている場合、注釈付きの詳細は木だけになります。

ただし、プロジェクトの要件が複雑で、ユーザーと共有するためにより多くの洞察が必要な場合、注釈には、木の名前、植物名、土壌と天候の要件、理想的な成長温度などの詳細を含める必要があります。

これらの情報を使用して、マシンは入力を分析および処理し、エンドユーザーに正確な結果を提供します。

画像注釈の種類

通常、画像にはいくつかの要素が含まれています。 特定の被写体やオブジェクトに焦点を合わせることができますが、それでも写真には他の要素が含まれます。 これらのオブジェクトは分析に必要な場合もあれば、バイアスやデータの偏りを避けるために削除する必要がある場合もあります。 インスタンスに関係なく、マシンは独自の決定を行うためにイメージ内のすべての要素を知る必要があります。 画像の注釈には、他のオブジェクトの識別も含まれます。 これはプロジェクトごとに異なりますが、さまざまな画像注釈機能を考えておくとよいでしょう。

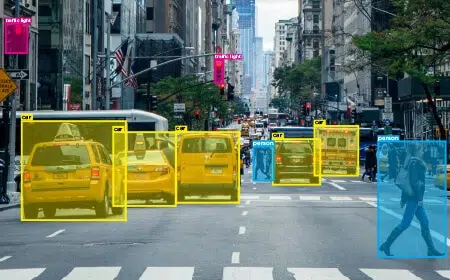

それがどのように行われるかを視覚的に把握するために、次の画像を参照として使用しましょう。 お気づきの方もいらっしゃると思いますが、画像はシンプルでクリアに見えますが、その中のさまざまな要素の数に注意してください。 車、建物、横断歩道、信号機などがあります。 さらに洗練すると、タクシーや自家用車、建物や高層ビル、看板などがあります。 画像の注釈とは、細部に至ることです。

画像注釈の種類

画像分類

オブジェクトが大まかに分類される最も基本的なタイプ。 したがって、ここでは、プロセスには、車両、建物、信号機などの要素を識別するだけが含まれます。

オブジェクト検出

さまざまなオブジェクトが識別され、注釈が付けられる、もう少し具体的な関数。 車両には、車とタクシー、建物と高層ビル、車線1、2、またはそれ以上があります。

画像のセグメンテーション

これは、すべての画像の詳細になります。 これには、オブジェクトに関する情報(色、場所の外観など)を追加して、マシンを区別しやすくすることが含まれます。 たとえば、中央の車両はレーン2の黄色いタクシーになります。

オブジェクトトラッキング

これには、同じデータセット内の複数のフレームにわたる場所やその他の属性などのオブジェクトの詳細を識別することが含まれます。 ビデオや監視カメラからの映像を追跡して、オブジェクトの動きやパターンの調査を行うことができます。

画像注釈技術

画像の注釈は、さまざまな手法とプロセスを通じて行われます。 画像の注釈を開始するには、特定の機能を提供するソフトウェアアプリケーションと、プロジェクトの要件に基づいて画像に注釈を付けるために必要なツールが必要です。

初心者向けに、特定のユースケースに合わせて変更できる市販の画像注釈ツールがいくつかあります。 オープンソースのツールもあります。 ただし、要件がニッチであり、商用ツールによって提供されるモジュールが基本的すぎると感じる場合は、プロジェクト用に開発されたカスタム画像注釈ツールを入手できます。 これは明らかに、より高価で時間がかかります。

作成またはサブスクライブするツールに関係なく、普遍的な特定の画像注釈手法があります。 それらが何であるかを見てみましょう。

バウンディングボックス

最も基本的な画像注釈手法では、専門家または注釈者がオブジェクトの周囲にボックスを描画して、オブジェクト固有の詳細を属性付けします。 この手法は、形状が対称的なオブジェクトに注釈を付けるのに最も理想的です。

バウンディングボックスのもう3つのバリエーションは、直方体です。 これらはバウンディングボックスのXNUMXDバリアントであり、通常はXNUMX次元です。 直方体は、より正確な詳細を得るために、寸法全体でオブジェクトを追跡します。 上の画像を考慮すると、車両にはバウンディングボックスを介して簡単に注釈を付けることができます。

より良いアイデアを提供するために、2Dボックスはオブジェクトの長さと幅の詳細を提供します。 ただし、直方体の手法では、オブジェクトの深さの詳細も表示されます。 直方体で画像に注釈を付けると、オブジェクトが部分的にしか表示されない場合に負担が大きくなります。 このような場合、アノテーターは既存のビジュアルと情報に基づいてオブジェクトのエッジとコーナーを概算します。

ランドマーク

この手法は、画像やフッテージ内のオブジェクトの動きの複雑さを引き出すために使用されます。 また、小さなオブジェクトを検出して注釈を付けるためにも使用できます。 ランドマークは特に 顔認識 注釈付きの顔の特徴、ジェスチャー、表情、姿勢などに。 正確な結果を得るために、顔の特徴とその属性を個別に特定する必要があります。

ランドマークが役立つ実際の例を示すために、顔の特徴や表情に基づいて帽子、ゴーグル、またはその他の面白い要素を正確に配置するInstagramまたはSnapchatフィルターについて考えてみてください。 したがって、次に犬のフィルターのポーズをとるときは、アプリが顔の特徴を目印にして正確な結果を得ていることを理解してください。

ポリゴン

画像内のオブジェクトは、常に対称的または規則的であるとは限りません。 それらが不規則または単にランダムであることがわかる場合がたくさんあります。 このような場合、アノテーターはポリゴン手法を展開して、不規則な形状やオブジェクトに正確に注釈を付けます。 この手法では、オブジェクトの寸法全体にドットを配置し、オブジェクトの円周または周囲に沿って手動で線を描画します。

ラインズ

基本的な形状やポリゴンの他に、画像内のオブジェクトに注釈を付けるために単純な線も使用されます。 この手法により、マシンはシームレスに境界を識別できます。 たとえば、自動運転車の機械の走行車線を横切って線が引かれ、操縦する必要のある境界をよりよく理解します。 ラインは、さまざまなシナリオや状況に合わせてこれらのマシンやシステムをトレーニングし、より良い運転の決定を下すのに役立ちます。

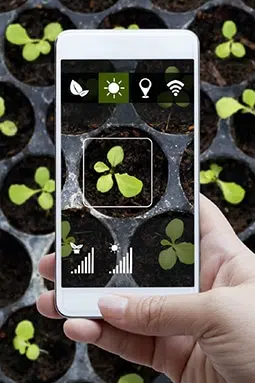

画像注釈のユースケース

このセクションでは、画像アノテーションまたは画像ラベリングを使用して、それぞれの業界に基づいて特定のタスクを実行するようにMLモデルをトレーニングする方法について説明します。

小売: ショッピングモールや食料品店では、2Dバウンディングボックス技術を使用して、シャツ、ズボン、ジャケット、人物などの店内商品の画像にラベルを付け、価格、色、色などのさまざまな属性でMLモデルを効果的にトレーニングできます。デザイン等

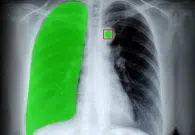

健康管理: ポリゴン技術を使用して、医療用X線で人間の臓器に注釈を付けたりラベルを付けたりして、MLモデルをトレーニングして人間のX線の変形を特定できます。 これは最も重要なユースケースのXNUMXつであり、 ヘルスケア 病気を特定し、コストを削減し、患者の体験を改善することにより、業界。

自動運転車: 自動運転の成功はすでに見てきましたが、まだまだ先は長いです。 多くの自動車メーカーは、画像の各ピクセルにラベルを付けて道路、車、信号機、ポール、歩行者などを識別するセマンティックセグメンテーションに依存する前述のテクノロジーをまだ採用していないため、車両は周囲の状況を認識できます。邪魔になる障害物を感知します。

感情の検出: ランドマーク注釈は、人間の感情/感情(幸せ、悲しみ、または中立)を検出して、特定のコンテンツでの被験者の感情的な心の状態を測定するために使用されます。 感情の検出または 感情分析 製品レビュー、サービスレビュー、映画レビュー、電子メールの苦情/フィードバック、カスタマーコール、会議などに使用できます。

サプライチェーン: ラインとスプラインは、倉庫内のレーンにラベルを付けて、配達場所に基づいてラックを識別するために使用されます。これにより、ロボットが経路を最適化し、配達チェーンを自動化して、人の介入とエラーを最小限に抑えることができます。

画像注釈にどのようにアプローチしますか:社内と外部委託?

画像の注釈には、お金だけでなく時間と労力の面でも投資が必要です。 すでに述べたように、綿密な計画と勤勉な関与を必要とするのは労働集約的です。 画像アノテーターの属性は、マシンが処理して結果を提供するものです。 したがって、画像の注釈フェーズは非常に重要です。

現在、ビジネスの観点から、画像に注釈を付けるにはXNUMXつの方法があります。

- あなたはそれを社内で行うことができます

- または、プロセスを外部委託することもできます

どちらもユニークであり、賛否両論の独自の公正なシェアを提供します。 それらを客観的に見てみましょう。

社内で

この場合、既存の人材プールまたはチームメンバーが画像の注釈タスクを処理します。 社内の手法は、データ生成ソースが適切に配置されている、適切なツールがある、または データ注釈 プラットフォーム、および注釈タスクを実行するための適切なスキルセットを備えた適切なチーム。

これは、専用のリソースやチームに投資できる企業または企業チェーンの場合に最適です。 企業または市場のプレーヤーであるため、トレーニングプロセスを開始するために重要なデータセットが不足することもありません。

アウトソーシング

これは、画像注釈タスクを実行するために必要な経験と専門知識を持つチームに仕事を与える、画像注釈タスクを実行するためのもうXNUMXつの方法です。 あなたがしなければならないのは彼らとあなたの要件と期限を共有することです、そして彼らはあなたが時間内にあなたの成果物を持っていることを保証します。

アウトソーシングされたチームは、あなたのビジネスと同じ都市または近隣にいるか、地理的にまったく異なる場所にいる可能性があります。 アウトソーシングで重要なのは、仕事への実践的な露出と画像に注釈を付ける方法の知識です。

画像の注釈:アウトソーシングと社内チーム–知っておくべきことすべて

| アウトソーシング | 社内で |

|---|---|

| プロジェクトを別のチームにアウトソーシングする場合は、データの整合性と機密性を確保するために、条項とプロトコルの追加レイヤーを実装する必要があります。 | データセットに取り組む専用の社内リソースがある場合、データの機密性をシームレスに維持します。 |

| 画像データのあり方をカスタマイズできます。 | ニーズに合わせてデータ生成ソースを調整できます。 |

| データのクリーニングに追加の時間を費やしてから、注釈の作成に取り掛かる必要はありません。 | 注釈を付ける前に、生データのクリーニングにさらに時間を費やすように従業員に依頼する必要があります。 |

| コラボレーションする前にプロセス、要件、および計画を完全に計画しているので、関連するリソースの過労はありません。 | データ注釈は既存の役割における追加の責任であるため、リソースを酷使することになります。 |

| データ品質に妥協することなく、期限は常に守られています。 | チームメンバーが少なく、タスクが多い場合、期限が長くなる可能性があります。 |

| アウトソーシングされたチームは、新しいガイドラインの変更により適応します。 | 要件とガイドラインからピボットするたびに、チームメンバーの士気が低下します。 |

| データ生成ソースを維持する必要はありません。 最終製品は時間通りに届きます。 | あなたはデータを生成する責任があります。 プロジェクトで数百万の画像データが必要な場合は、関連するデータセットを調達する必要があります。 |

| ワークロードのスケーラビリティやチームサイズは決して問題ではありません。 | 迅速な意思決定をシームレスに行うことができないため、スケーラビリティは大きな懸念事項です。 |

ボトムライン

はっきりとわかるように、社内の画像/データ注釈チームを持つ方が便利なように見えますが、長期的にはプロセス全体をアウトソーシングする方が収益性が高くなります。 専任の専門家と共同作業を行うと、そもそも実行する必要がなかったいくつかのタスクと責任を自分で負わせることができます。 この理解を踏まえて、適切なデータ注釈ベンダーまたはチームを見つける方法をさらに理解しましょう。

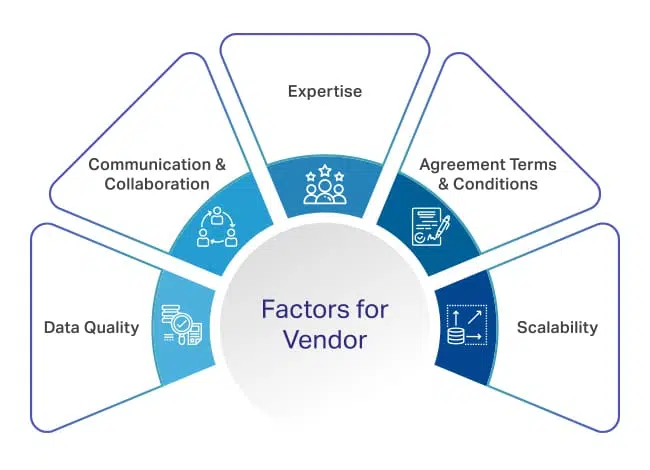

データ注釈ベンダーを選択する際に考慮すべき要素

これは大きな責任であり、機械学習モジュールの全体的なパフォーマンスは、ベンダーが提供するデータセットの品質とタイミングに依存します。 そのため、契約に署名する前に、誰と話すか、何を提供すると約束しているかにもっと注意を払い、より多くの要素を考慮する必要があります。

あなたが始めるのを助けるために、あなたが考慮しなければならないいくつかの重要な要素がここにあります。

専門性

考慮すべき主な要因のXNUMXつは、機械学習プロジェクトに採用する予定のベンダーまたはチームの専門知識です。 選択するチームは、最も実践的な露出を持つ必要があります データ注釈 ツール、テクニック、ドメイン知識、および複数の業界での作業経験。

技術に加えて、スムーズなコラボレーションと一貫したコミュニケーションを確保するためのワークフロー最適化手法も実装する必要があります。 詳細については、次の点について質問してください。

- 彼らが取り組んできた以前のプロジェクトはあなたのものと似ています

- 彼らが持っている長年の経験

- アノテーションのために展開するツールとリソースの武器

- 一貫したデータ注釈と時間通りの配信を保証する方法

- プロジェクトのスケーラビリティなどの点で、どれほど快適で準備ができているか

データ品質

データ品質はプロジェクトの出力に直接影響します。 苦労、ネットワーキング、投資のすべての年は、起動前のモジュールのパフォーマンスにかかっています。 したがって、協力する予定のベンダーがプロジェクトに最高品質のデータセットを提供するようにしてください。 より良いアイデアを得るのを助けるために、ここにあなたが調べるべき簡単なチートシートがあります:

- ベンダーはデータ品質をどのように測定していますか? 標準的な指標は何ですか?

- 品質保証プロトコルと苦情処理プロセスの詳細

- あるチームメンバーから別のチームメンバーへの知識の伝達をどのように保証しますか?

- その後ボリュームが増加した場合、データ品質を維持できますか?

コミュニケーションとコラボレーション

高品質の出力を提供しても、必ずしもスムーズなコラボレーションにつながるとは限りません。 シームレスなコミュニケーションと優れた信頼関係の維持も含まれます。 コラボレーションの全過程で更新を提供しないチームや、ループから抜け出し、締め切り時に突然プロジェクトを提供するチームと協力することはできません。

そのため、バランスが不可欠になり、コラボレーションに対する彼らの手口と一般的な態度に細心の注意を払う必要があります。 そのため、コミュニケーション方法、ガイドラインや要件の変更への適応性、プロジェクト要件の縮小などについて質問し、関係者の両方がスムーズに進むようにします。

契約条件

これらの側面とは別に、合法性と規制の観点から避けられないいくつかの角度と要因があります。 これには、価格設定条件、コラボレーションの期間、関連付けの条件と条件、職務の割り当てと指定、明確に定義された境界などが含まれます。

契約書に署名する前に、それらを分類してください。 より良いアイデアを提供するために、ここに要因のリストがあります:

- 支払い条件と価格設定モデルについて質問します–価格設定がXNUMX時間ごとに行われた作業に対するものか、注釈ごとによるものか

- 支払いは毎月、毎週、または隔週ですか?

- プロジェクトのガイドラインまたは作業範囲に変更があった場合の価格設定モデルの影響

スケーラビリティ

あなたのビジネスは将来成長し、あなたのプロジェクトの範囲は指数関数的に拡大するでしょう。 このような場合、ベンダーがビジネスで必要とされる大量のラベル付き画像を大規模に提供できることを確信する必要があります。

彼らは社内に十分な才能を持っていますか? 彼らはすべてのデータソースを使い果たしていますか? 固有のニーズとユースケースに基づいてデータをカスタマイズできますか? このような側面により、大量のデータが必要になったときにベンダーが移行できるようになります。

アップラッピング

これらの要素を検討すれば、コラボレーションがシームレスで支障がないことを確認できます。画像注釈タスクを専門家にアウトソーシングすることをお勧めします。 のような一流企業を探してください シャイプ、ガイドに記載されているすべてのチェックボックスをオンにします。

人工知能の分野に何十年も携わってきた私たちは、このテクノロジーの進化を見てきました。 私たちはそれがどのように始まったのか、どのように進んでいるのか、そしてその将来を知っています。 ですから、私たちは最新の進歩に遅れないようにするだけでなく、将来にも備えています。

さらに、専門家を厳選して、データと画像にプロジェクトの最高レベルの精度で注釈が付けられるようにします。 あなたのプロジェクトがどんなにニッチでユニークであっても、私たちから非の打ちどころのないデータ品質を得ることが常に保証されます。

単に私たちに連絡してあなたの要件について話し合うだけで、私たちはすぐにそれを始めます。 連絡する 今日私たちと一緒に。

話しましょう

よくある質問(FAQ)

画像アノテーションはデータラベリングのサブセットであり、画像のタグ付け、文字起こし、またはバックエンドで人間が関与するラベリングという名前でも知られています。メタデータ情報と属性で画像に飽くなきタグを付け、マシンがオブジェクトをより適切に識別できるようにします。

An 画像注釈/ラベリングツール は、マシンがオブジェクトをより適切に識別するのに役立つメタデータ情報と属性で画像にラベルを付けるために使用できるソフトウェアです。

画像のラベル付け/注釈サービスは、お客様に代わって画像にラベルを付けたり注釈を付けたりするサードパーティベンダーが提供するサービスです。 これらは、必要な専門知識、品質の敏捷性、および必要に応じたスケーラビリティを提供します。

ラベル付き/注釈付き画像 は、画像を説明するメタデータでラベル付けされており、機械学習アルゴリズムで理解できるようになっています。

機械学習または深層学習用の画像注釈 ラベルや説明を追加したり、画像を分類して、モデルに認識させたいデータポイントを表示するプロセスです。 つまり、関連するメタデータを追加して、マシンで認識できるようにします。

画像注釈 バウンディングボックス(2-d、3-d)、ランドマーク、ポリゴン、ポリラインなど、これらの手法のXNUMXつ以上を使用する必要があります。