AIデータ収集のビギナーズガイド

AI / MLプロジェクトにAIデータ収集会社を選択する

概要

現在、私たちはAIの助けを借りて、業界全体で大きなブレークスルーが起こっているという正しい道を歩んでいます。 たとえば医療を例にとると、機械学習モデルを伴うAIシステムは、専門家が癌をよりよく理解し、その治療法を考え出すのに役立ちます。 神経障害やPTSDのような懸念はAIの助けを借りて治療されています。 AIを活用した臨床試験とシミュレーションのおかげで、ワクチンは急速に開発されています。

ヘルスケアだけでなく、AIが触れるすべての業界またはセグメントに革命が起こっています。 自動運転車、スマートコンビニエンスストア、FitBitなどのウェアラブル、さらにはスマートフォンのカメラでさえ、AIを使用して顔のより良い画像をキャプチャできます。

AIの分野で起こっているイノベーションのおかげで、企業はさまざまなユースケースとソリューションでさまざまな分野に参入しています。 このため、世界のAI市場は267年末までに約2027億ドルの市場価値に達すると予想されています。さらに、世界中の企業の約37%がすでにプロセスや製品にAIソリューションを実装しています。

さらに興味深いことに、現在使用している製品とサービスの77%近くがAIを利用しています。 技術コンセプトが業種を超えて大幅に上昇している中で、企業はどのようにしてAIで不可能なことを成し遂げることができますか?

チャットボットは、私たちが反対側の別の人間と話しているとどのように信じさせますか?

すべての質問に対する答えを観察すると、それはXNUMXつの要素であるDATAに要約されます。 データは、AI固有のすべての操作とプロセスの中心にあります。 これは、機械が概念を理解し、入力を処理し、正確な結果を提供するのに役立つデータです。

そこにあるすべての主要なAIソリューションは、データ収集、データ取得、またはAIトレーニングデータと呼ばれる重要なプロセスのすべての製品です。

この広範なガイドは、それが何であるか、そしてなぜそれが重要であるかを理解するのを助けることについてのすべてです。

AIデータ収集とは何ですか?

機械はそれ自身の心を持っていません。 この抽象的な概念がないため、意見、事実、推論、認知などの能力が欠けています。 それらは、スペースを占める不動のボックスまたはデバイスです。 それらを強力な媒体に変えるには、アルゴリズム、さらに重要なことにデータが必要です。

私たちが今日使用しているすべてのAI対応製品またはソリューションとそれらが提供する結果は、長年のトレーニング、開発、および最適化から生じています。 ナビゲーションルートを提供するデバイスから、機器の故障を数日前に予測する複雑なシステムまで、すべてのエンティティは、正確に結果を提供できるようにするために、何年にもわたるAIトレーニングを受けてきました。

AIデータ収集 は、AI 開発プロセスの最初のステップであり、AI システムがどれほど効果的かつ効率的であるかを最初から決定します。 これは、無数のソースから関連するデータセットを調達するプロセスであり、AI モデルが詳細をより適切に処理し、意味のある結果を生み出すのに役立ちます。

機械学習における AI トレーニング データの種類

現在、AIデータ収集は総称です。 このスペースのデータは何を意味する可能性があります。 それは、テキスト、ビデオ映像、画像、オーディオ、またはこれらすべての組み合わせである可能性があります。 つまり、マシンが結果の学習と最適化のタスクを実行するのに役立つものはすべてデータです。 さまざまなタイプのデータに関するより多くの洞察を提供するために、ここにクイックリストがあります:

データセットは、構造化ソースまたは非構造化ソースからのものである可能性があります。 開始されていない構造化データセットの場合、明示的な意味と形式を持つデータセットです。 それらは機械で簡単に理解できます。 一方、非構造化は、至る所にあるデータセットの詳細です。 それらは特定の構造や形式に従わず、そのようなデータセットから貴重な洞察を引き出すために人間の介入を必要とします。

テキストデータ

最も豊富で目立つ形式のデータのXNUMXつ。 テキストデータは、データベース、GPSナビゲーションユニット、スプレッドシート、医療機器、フォームなどからの洞察の形で構造化できます。 非構造化テキストには、調査、手書きのドキュメント、テキストの画像、電子メールの返信、ソーシャルメディアのコメントなどがあります。

オーディオデータ

オーディオデータセットは、企業がより優れたチャットボットとシステムを開発し、より優れた仮想アシスタントを設計するのに役立ちます。 また、単一の質問やクエリを尋ねるさまざまな方法に対するアクセントや発音を機械が理解するのにも役立ちます。

画像データ

画像は、さまざまな目的で使用されるもうXNUMXつの著名なデータセットタイプです。 自動運転車やGoogleレンズなどのアプリケーションから顔認識まで、画像はシステムがシームレスなソリューションを生み出すのに役立ちます。

ビデオデータ

ビデオは、マシンが何かを深く理解できるようにする、より詳細なデータセットです。 ビデオデータセットは、コンピュータビジョン、デジタル画像などから供給されます。

機械学習のためにデータを収集するには?

では、どのようにデータを調達しますか? どのようなデータが必要で、どれだけのデータが必要ですか? 関連データをフェッチするための複数のソースは何ですか?

企業は、MLモデルのニッチと目的を評価し、関連するデータセットを調達するための潜在的な方法を示します。 必要なデータ型を定義することで、データソーシングに関する懸念の大部分が解決されます。 より良いアイデアを提供するために、データ収集にはさまざまなチャネル、手段、ソース、または媒体があります。

無料のソース

名前が示すように、これらはAIトレーニングの目的でデータセットを無料で提供するリソースです。 無料のソースは、公開フォーラム、検索エンジン、データベース、ディレクトリから、長年にわたって情報のアーカイブを維持している政府のポータルに至るまで、あらゆるものである可能性があります。

無料のデータセットの調達にあまり力を入れたくない場合は、Kaggle、AWSリソース、UCIデータベースなど、さまざまなものを探索できる専用のWebサイトやポータルがあります。

カテゴリを作成し、必要なデータセットを無料でダウンロードします。

内部リソース

無料のリソースは便利なオプションのように見えますが、それに関連するいくつかの制限があります。 まず、要件に正確に一致するデータセットが見つかるとは限りません。 それらが一致していても、データセットはタイムラインの観点からは無関係である可能性があります。

市場セグメントが比較的新しいか未踏の場合、多くのカテゴリや関連性はありません

ダウンロードするデータセットもあります。 無料のリソースによる予備的な欠点を回避するために、

より関連性の高いコンテキストデータセットを生成するためのチャネルとして機能する別のデータリソースが存在します。

これらは、CRMデータベース、フォーム、メールマーケティングリード、製品またはサービスで定義されたタッチポイント、ユーザーデータ、ウェアラブルデバイスからのデータ、Webサイトのデータ、ヒートマップ、ソーシャルメディアの洞察などの内部ソースです。 これらの内部リソースは、ユーザーが定義、設定、および保守します。 したがって、その信頼性、関連性、および最新性を確信できます。

有料リソース

それらがどれほど有用に聞こえても、内部リソースにも複雑さと制限がかなりあります。 たとえば、人材プールの焦点のほとんどは、データのタッチポイントの最適化にあります。 さらに、チームとリソース間の調整も非の打ちどころがない必要があります。

このような問題をさらに回避するために、ソースを支払いました。 これらは、プロジェクトに最も有用でコンテキストに応じたデータセットを提供し、必要なときにいつでも一貫して取得できるようにするサービスです。

私たちのほとんどが有料のソースやデータベンダーに抱く第一印象は、それらが高価であるということです。 しかし、

あなたが数学をするとき、彼らは長期的には安いだけです。 広大なネットワークとデータソーシング手法のおかげで、AIプロジェクトの複雑なデータセットを、どれほど信じがたいものであっても受け取ることができます。

XNUMXつのソースの違いの詳細な概要を示すために、次の詳細な表を示します。

| 無料のリソース | 内部リソース | 有料リソース |

|---|---|---|

| データセットは無料で利用できます。 | 運用コストによっては、内部リソースも無料になる場合があります。 | データベンダーに支払いをして、関連するデータセットを調達します。 |

| 優先データセットをダウンロードするためにオンラインで利用できる複数の無料リソース。 | AIトレーニングのニーズに応じて、カスタム定義のデータを取得します。 | 必要な限り、カスタム定義のデータを一貫して取得できます。 |

| データセットのコンパイル、キュレーション、フォーマット、および注釈付けを手動で行う必要があります。 | データタッチポイントを変更して、必要な情報を含むデータセットを生成することもできます。 | ベンダーのデータセットは機械学習に対応しています。 つまり、注釈が付けられ、品質保証が付いています。 |

| ダウンロードするデータセットのライセンスとコンプライアンスの制約に注意してください。 | 製品の市場投入までの時間が限られている場合、内部リソースは危険にさらされます。 | 期限を定義し、それに応じてデータセットを配信することができます。 |

悪いデータはAIの野心にどのように影響しますか?

データの収集と調達に取り組む方法がわかるという理由で、最も一般的なXNUMXつのデータリソースをリストアップしました。 ただし、この時点で、あなたの決定が常にAIソリューションの運命を決定する可能性があることも理解することが不可欠になります。

高品質のAIトレーニングデータがモデルが正確でタイムリーな結果を提供するのに役立つのと同様に、悪いトレーニングデータも、AIモデルを壊し、結果を歪め、バイアスを導入し、その他の望ましくない結果をもたらす可能性があります。

しかし、なぜこれが起こるのでしょうか? AIモデルをトレーニングおよび最適化するためのデータはありませんか? 正直なところ、違います。 これをさらに理解しましょう。

悪いデータ–それは何ですか?

非構造化データと不良データの違いは、非構造化データの洞察がいたるところにあることです。 しかし、本質的には、それらは関係なく役立つ可能性があります。 追加の時間を費やすことにより、データサイエンティストは、非構造化データセットから関連情報を抽出することができます。 ただし、悪いデータの場合はそうではありません。 これらのデータセットには、AIプロジェクトまたはそのトレーニング目的に価値がある、または関連する洞察や情報が含まれていません。

したがって、無料のリソースからデータセットを入手したり、内部データのタッチポイントを大まかに確立したりすると、不良データをダウンロードまたは生成する可能性が高くなります。 科学者が悪いデータに取り組むとき、あなたは人間の時間を無駄にするだけでなく、あなたの製品の発売も推進しています。

悪いデータがあなたの野心に何をすることができるかについてまだ不明な場合は、ここに簡単なリストがあります:

- 悪いデータを調達するのに数え切れないほどの時間を費やし、リソースに時間、労力、お金を浪費します。

- 悪いデータは、気づかれていなければ法的な問題を引き起こし、AIの効率を低下させる可能性があります

モデル。 - 悪いデータでトレーニングされた製品をライブで使用すると、ユーザーエクスペリエンスに影響します

- 悪いデータは結果と推論にバイアスをかける可能性があり、それはさらに反発をもたらす可能性があります。

したがって、これに対する解決策があるかどうか疑問に思っている場合は、実際にあります。

AIトレーニングデータプロバイダーが救助に

あなたがしなければならないのは、データを取り込んで、AIモデルを完璧にトレーニングすることだけです。 そうは言っても、次の質問は、データベンダーとのコラボレーションに伴う費用についてです。 あなた方の何人かはすでに精神的な予算に取り組んでいることを私たちは理解しています、そしてそれはまさに私たちが次に向かっているところです。

データ収集プロジェクトの効果的な予算を立てる際に考慮すべき要素

AIトレーニングは体系的なアプローチであり、それが予算編成がその不可欠な部分になる理由です。 AI開発に多額の投資を行う前に、RoI、結果の精度、トレーニング方法などの要素を検討する必要があります。 多くのプロジェクトマネージャーやビジネスオーナーは、この段階で手探りします。 彼らは急いで決定を下し、製品開発プロセスに不可逆的な変化をもたらし、最終的にはより多くの費用を費やすことを余儀なくされます。

ただし、このセクションでは正しい洞察が得られます。 AIトレーニングの予算に取り組むために座っているとき、XNUMXつのことまたは要因が避けられません。

それぞれを詳しく見ていきましょう。

必要なデータの量

AIモデルの効率と精度は、トレーニングの量に依存するとずっと言ってきました。 これは、データセットの量が多いほど、学習が増えることを意味します。 しかし、これは非常にあいまいです。 この概念に数字を付けるために、Dimensional Researchは、企業がAIモデルをトレーニングするために最低100,000のサンプルデータセットが必要であることを明らかにしたレポートを公開しました。

100,000のデータセットとは、100,000の品質と関連するデータセットを意味します。 これらのデータセットには、アルゴリズムと機械学習モデルが情報を処理し、目的のタスクを実行するために必要なすべての重要な属性、注釈、洞察が含まれている必要があります。

これは一般的な経験則であるため、必要なデータの量は、ビジネスのユースケースである別の複雑な要因にも依存することをさらに理解しましょう。 製品またはソリューションで何をしようとするかによって、必要なデータの量も決まります。 たとえば、レコメンデーションエンジンを構築している企業は、チャットボットを構築している企業とは異なるデータ量の要件があります。

データ価格戦略

実際に必要なデータ量の確定が完了したら、次にデータの価格設定戦略に取り組む必要があります。 これは、簡単に言えば、調達または生成するデータセットに対してどのように支払うかを意味します。

一般に、これらは市場で採用されている従来の価格戦略です。

| データ型 | 価格戦略 |

|---|---|

| 単一の画像ファイルごとの価格 | |

| XNUMX秒、XNUMX分、XNUMX時間、または個々のフレームあたりの価格 | |

| XNUMX秒、XNUMX分、またはXNUMX時間あたりの価格 | |

| 単語または文ごとの価格 |

ちょっと待って。 これも経験則です。 データセットを調達する実際のコストは、次のような要因にも依存します。

- データセットを入手する必要のある独自の市場セグメント、人口統計、または地理

- ユースケースの複雑さ

- どのくらいのデータが必要ですか?

- 市場投入までの時間

- カスタマイズされた要件など

観察すると、AIプロジェクトで大量の画像を取得するためのコストは低くなる可能性がありますが、仕様が多すぎると価格が高騰する可能性があります。

あなたのソーシング戦略

これは注意が必要です。 ご覧のとおり、AIモデルのデータを生成または取得するにはさまざまな方法があります。 常識的に言えば、必要な量のデータセットを問題なく無料でダウンロードできるため、無料のリソースが最適です。

今のところ、有料のソースは高すぎるようにも見えます。 しかし、これは複雑さの層が追加される場所です。 無料のリソースからデータセットを調達する場合、データセットをクリーンアップし、ビジネス固有の形式にコンパイルしてから、個別に注釈を付けるために、追加の時間と労力を費やします。 その過程で運用コストが発生します。

有料ソースの場合、支払いはXNUMX回限りであり、必要なときにマシン対応のデータセットを手に入れることもできます。 ここでは、費用対効果は非常に主観的です。 無料のデータセットに注釈を付けることに時間を費やす余裕があると感じた場合は、それに応じて予算を立てることができます。 また、競争が激しく、市場投入までの時間が限られていると思われる場合は、市場に波及効果をもたらす可能性があります。有料のソースを選択する必要があります。

予算編成とは、詳細を分析し、各フラグメントを明確に定義することです。 これらのXNUMXつの要素は、将来のAIトレーニングの予算編成プロセスのロードマップとして役立つはずです。

社内のデータ取得で経費を節約していますか?

あなたがまだ有料のソースに躊躇していることを私たちは知っています、そしてそれがこのセクションがそれについてのあなたの懐疑論を取り除き、社内データ生成に伴う隠れたコストに光を当てる理由です。

社内のデータ取得は高価ですか?

はい、そうです!

さて、ここに精巧な応答があります。 費用はあなたが使うものです。 無料のリソースについて話し合っているときに、プロセスにお金、時間、労力を費やしていることを明らかにしました。 これは、社内のデータ取得にも当てはまります。

最終的には、従業員、データサイエンティスト、アノテーター、品質保証の専門家などに支払うことになります。 また、注釈ツールと

CMS、CRM、およびその他のインフラストラクチャ費用の保守。

さらに、データセットにはバイアスと精度の問題があり、手動で並べ替える必要があります。 また、AIトレーニングデータチームに離職の問題がある場合は、新しいメンバーの募集、プロセスへの方向付け、ツールを使用するためのトレーニングなどに費やす必要があります。

最終的には、長期的に見た場合よりも多くの費用を費やすことになります。 注釈費用もあります。 任意の時点で、社内データを処理するために発生する総コストは次のとおりです。

発生したコスト=アノテーターの数*アノテーターあたりのコスト+プラットフォームのコスト

AIトレーニングカレンダーが数か月に予定されている場合は、一貫して発生する費用を想像してください。 それで、これはデータ取得の懸念に対する理想的な解決策ですか、それとも代替手段はありますか?

エンドツーエンドの AI データ収集サービス プロバイダーの利点

この問題には信頼できる解決策があり、AIモデルのトレーニングデータを取得するためのより優れた安価な方法があります。 私たちはそれらをトレーニングデータサービスプロバイダーまたはデータベンダーと呼んでいます。

彼らは、独自のニーズと要件に基づいて高品質のデータセットを提供することを専門とするShaipのようなビジネスです。 関連するデータセットの調達、クリーニング、コンパイル、注釈付けなど、データ収集で直面するすべての煩わしさを取り除き、AIモデルとアルゴリズムの最適化のみに集中できます。 データベンダーと協力することで、重要なことに集中し、自分で管理できることに集中できます。

さらに、無料の内部リソースからデータセットを調達することに関連するすべての面倒を排除します。 エンドツーエンドのデータプロバイダーの利点をよりよく理解するために、以下にクイックリストを示します。

- トレーニングデータサービスプロバイダーは、市場セグメント、ユースケース、人口統計、その他の詳細を完全に理解して、AIモデルに最も関連性の高いデータを取得します。

- 画像、動画、テキスト、音声ファイル、またはこれらすべてなど、プロジェクトに適していると思われるさまざまなデータセットを調達する機能があります。

- データベンダーは、データをクリーンアップして構造化し、マシンとアルゴリズムが学習して処理するために必要な属性と洞察をタグ付けします。 これは手作業であり、細部と時間に細心の注意を払う必要があります。

- 重要な情報に注釈を付けることを担当する対象分野の専門家がいます。 たとえば、製品のユースケースがヘルスケア分野にある場合、ヘルスケア以外の専門家から注釈を付けて、正確な結果を期待することはできません。 データベンダーの場合、そうではありません。 彼らは中小企業と協力し、あなたのデジタル画像データが業界のベテランによって適切に注釈されていることを保証します。

- また、データの匿名化を処理し、HIPAAまたはその他の業界固有のコンプライアンスとプロトコルに準拠しているため、あらゆる形態の法的な問題を回避できます。

- データベンダーは、データセットからバイアスを排除し、客観的な結果と推論を確実に得るように精力的に取り組んでいます。

- また、ニッチ市場で最新のデータセットを受け取るため、AIモデルが最適な効率で最適化されます。

- また、操作も簡単です。 たとえば、データ要件の突然の変更を彼らに伝えることができ、彼らは更新されたニーズに基づいて適切なデータをシームレスに調達します。

これらの要素により、トレーニングデータプロバイダーとのコラボレーションがいかに費用効果が高くシンプルであるかを理解できたと確信しています。 この理解の下で、AIプロジェクトに最も理想的なデータベンダーを選択する方法を見つけましょう。

関連するデータセットの調達

市場、ユースケース、人口統計を理解して、画像、動画、テキスト、音声などの最近のデータセットを入手します。

関連データをクリーンアップ

マシンとアルゴリズムが理解できる属性と洞察でデータを構造化し、タグ付けします。

データバイアス

データセットからバイアスを排除し、客観的な結果と推論が得られるようにします。

データ注釈

特定のドメインの対象分野の専門家が、重要な情報に注釈を付けます。

データの匿名化

法的な複雑さを排除するために、HIPAA、GDPR、またはその他の業界固有のコンプライアンスとプロトコルを順守してください。

適切なAIデータ収集会社を選択する方法

AIデータ収集会社の選択は、無料のリソースからデータを収集するほど複雑でも時間もかかりません。 考慮し、コラボレーションのために握手する必要がある単純な要素はごくわずかです。

あなたがデータベンダーを探し始めているとき、私たちはあなたがこれまでに議論したことを何でもフォローして検討したと仮定します。 ただし、ここに簡単な要約があります。

- 明確に定義されたユースケースを念頭に置いています

- 市場セグメントとデータ要件が明確に確立されている

- あなたの予算は適切です

- そして、あなたはあなたが必要とするデータの量についての考えを持っています

これらの項目をオフにして、理想的なトレーニングデータサービスプロバイダーを探す方法を理解しましょう。

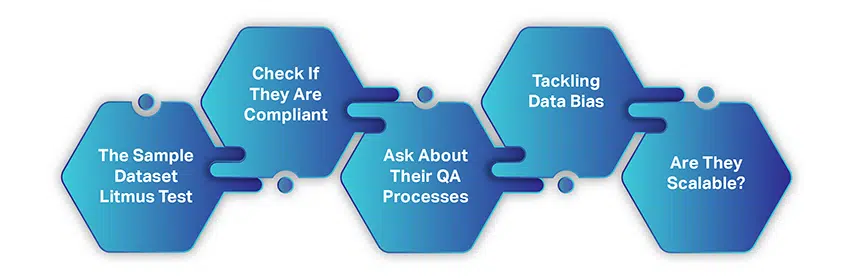

サンプルデータセットリトマス試験

長期契約に署名する前に、データベンダーを詳細に理解することをお勧めします。 したがって、料金を支払うサンプルデータセットの要件からコラボレーションを開始します。

これは、要件を理解しているかどうか、適切な調達戦略を実施しているかどうか、コラボレーション手順、透明性などを評価するための少量のデータセットである可能性があります。 この時点で複数のベンダーと連絡を取ることになるという事実を考慮すると、これはプロバイダーを決定する時間を節約し、最終的にニーズに適したベンダーを決定するのに役立ちます。

それらが準拠しているかどうかを確認します

デフォルトでは、ほとんどのトレーニングデータサービスプロバイダーは、すべての規制要件とプロトコルに準拠しています。 ただし、念のため、コンプライアンスとポリシーについて問い合わせてから、選択を絞り込んでください。

QAプロセスについて質問する

データ収集のプロセス自体は体系的で階層化されています。 実装される線形方法論があります。 それらがどのように動作するかを理解するには、QAプロセスについて質問し、ソースと注釈を付けたデータセットが品質チェックと監査に合格しているかどうかを確認します。 これはあなたに

あなたが受け取る最終的な成果物が機械の準備ができているかどうかについての考え。

データバイアスへの取り組み

情報に通じた顧客だけが、トレーニングデータセットのバイアスについて質問します。 トレーニングデータベンダーと話しているときは、データバイアスと、それらが生成または調達するデータセットのバイアスをどのように排除するかについて話します。 偏見を完全に排除することは難しいのが常識ですが、偏見を寄せ付けないために従うべきベストプラクティスを知ることはできます。

それらはスケーラブルですか?

一度限りの成果物は良いです。 長期的な成果物の方が優れています。 ただし、最良のコラボレーションは、ビジネスビジョンをサポートし、同時に成果物を拡大することです。

要件。

したがって、必要に応じて、話しているベンダーがデータ量の観点からスケールアップできるかどうかについて話し合ってください。 そして可能であれば、それに応じて価格戦略がどのように変わるか。

まとめ

最高のAIトレーニングデータプロバイダーを見つけるためのショートカットを知りたいですか? 私たちと連絡を取ってください。 これらの面倒なプロセスをすべてスキップして、AIモデルの最も高品質で正確なデータセットを作成してください。

これまでに説明したすべてのチェックボックスをオンにします。 この分野のパイオニアである私たちは、AIモデルの構築とスケーリングに何が必要か、そしてデータがすべての中心にあることを知っています。

また、バイヤーズガイドはさまざまな方法で広範かつ機知に富んでいたと考えています。 AIトレーニングはそのままでは複雑ですが、これらの提案や推奨事項を使用すると、面倒な作業を減らすことができます。 結局、あなたの製品は、これらすべてから最終的に利益を得る唯一の要素です。

同意しませんか?